Robot senza etica che fanno la guerra

22 Settembre 2011 Pubblicato da Pino Bruno

- 22 Settembre 2011

- ATTUALITA', SCENARI DIGITALI, SCIENZE

- drone, guerra, Isaac Asimov, le tre leggi della robotica di Isac Asimov, SCIENZE

- 1 Commento

Tre anni fa ci aveva provato lo scienziato britannico Noel Sharkey, che su Science aveva affrontato il problema dell’Ethical Frontiers of Robotics. Ne scrissi un post, in cui sostenevo che sarebbe sufficiente attenersi alle tre leggi della robotica di Isaac Asimov[1], in difesa degli umani. In tre anni molte cose sono cambiate, i robot si sono evoluti, l’intelligenza artificiale ha fatto passi da gigante, ma l’etica è sempre cenerentola. Così il politologo Peter Warren Singer – questa volta su Nature – ripresenta il tema, soffermandosi sulla preoccupante deriva dell’uso bellico dei robot.

Dalla fusione dei metalli all’energia nucleare ai robot oggi, secondo Singer la storia è piena di tecnologie militari talmente importanti e distruttive da aver cambiato le nostre vite. Tuttavia, rileva l’esperto, la velocità di risposta ai problemi etici da parte della ricerca e della politica è oggi troppo lenta in confronto alla rapidità dei progressi del settore.

“Siamo giganti quando si tratta di parlare di tecnologia ma siamo eticamente bambini nel comprendere le conseguenze”, rileva l’esperto ricordando le parole del generale Usa Omar Bradley pronunciate nel 1948. L’esperto cita ad esempio come l’aeronautica americana abbia recentemente definito che anche i droni hanno il diritto di difendersi e offendere se individuati da un radar. Decisione sensata in una prospettiva militare, osserva Singer, ma che è in grado di creare dispute legali internazionali realizzando il primo, probabilmente involontario, passo per la causa dei diritti dei robot.

Un altro esempio riguarda la dichiarazione, fatta recentemente dal presidente Usa, Barack Obama, di non aver bisogno di ratifica da parte del Congresso per approvare le operazioni militari in Libia, in quanto svolte da sistemi di attacco senza uomini.

Le questioni etiche relative all’uso dei robot sono destinate, secondo Singer, a trasferirsi molto rapidamente in ambito civile, ad esempio con strumenti di controllo a disposizione della polizia.

Fin qui Peter Warren Singer.

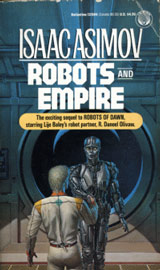

Le scorciatoie etiche addotte dai politici per giustificare il dilagare di robot da guerra mi fanno venire a mente la cosiddetta “Quarta Legge (o Legge Zero)” di Asimov, enunciata nel romanzo “I Robot e l’Impero”: “Un robot non può recare danno all’umanità, né può permettere che, a causa del proprio mancato intervento, l’umanità riceva danno”.

Tutto dipende dal concetto di “umanità”. Insomma, fatta la legge (della robotica), trovato l’inganno.

Fonti: Ansa, Nature, Wikipedia.

[1] 1)Un robot non può recare danno a un essere umano, né può permettere che, a causa del suo mancato intervento, un essere umano riceva danno;

2) Un robot deve obbedire agli ordini impartiti dagli esseri umani, purché tali ordini non contrastino con la Prima Legge;

3)Un robot deve proteggere la propria esistenza, purché questa autodifesa non contrasti con la Prima e/o la Seconda Legge. (http://it.wikipedia.org/wiki/Tre_leggi_della_robotica)